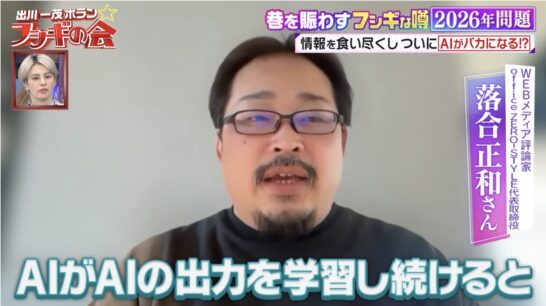

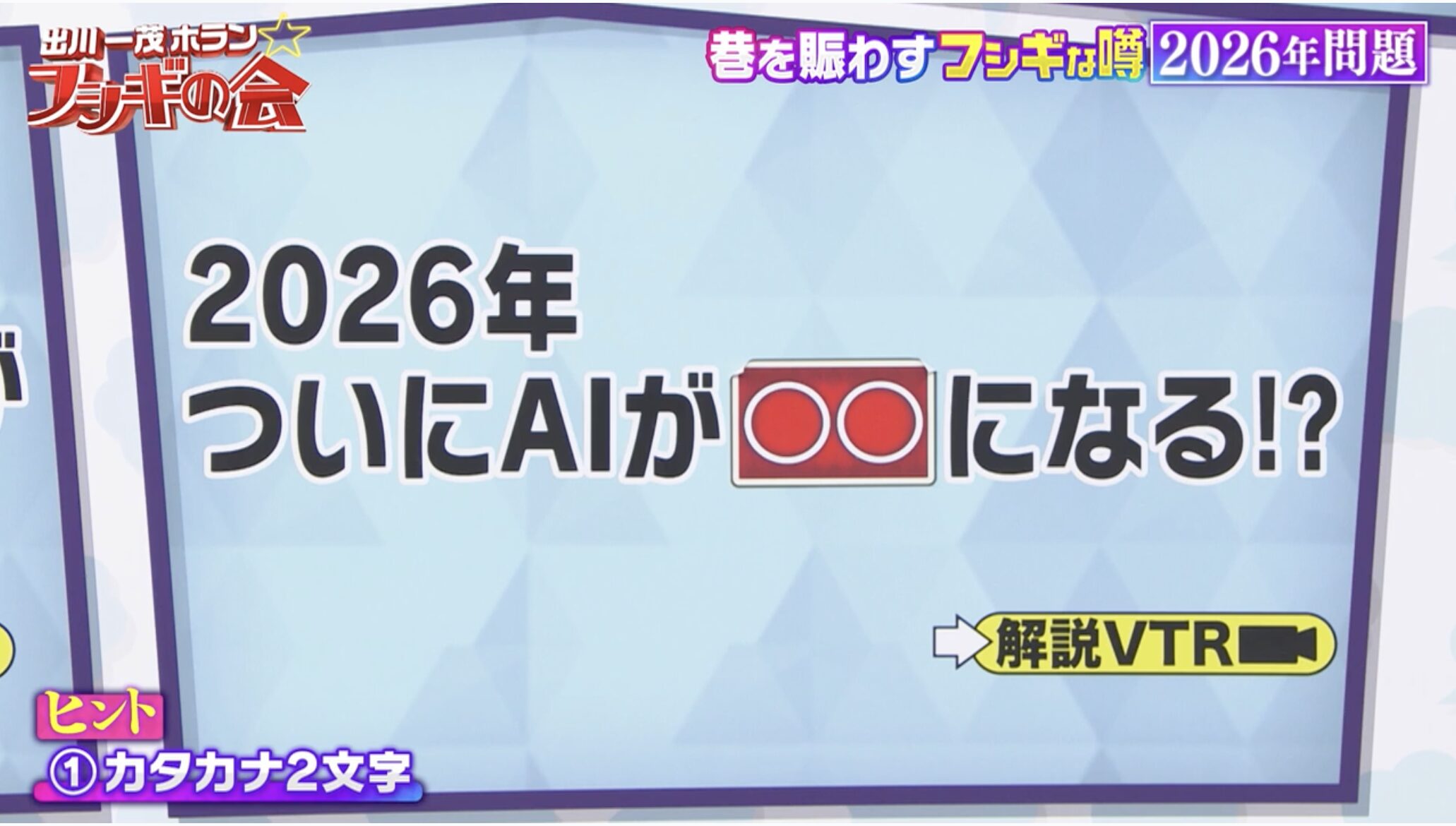

テレビ朝日「出川一茂ホラン☆フシギの会」に、生成AIの専門家として出演しました。

今回で僕のテレビ出演は50番組目。ちょうど節目の出演になりました。

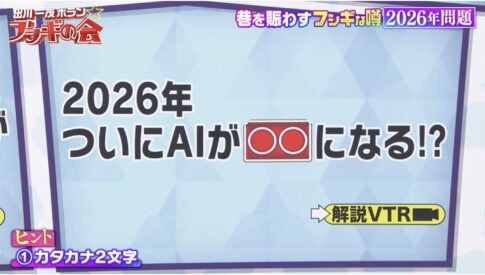

テーマは「AIモデルコラプス」。番組では「AIがバカになる」というキャッチーな切り口で取り上げていただきましたが、これは知っていても損はない事象でしょう。

目次

AIモデル崩壊(AIモデルコラプス)とは何か

AIモデル崩壊(AIモデルコラプス)とは、AIが「AIが作ったデータ」を学習し続けることで、徐々に回答の質が低下ししてしまう現象のことです。

人間で例えると、「また聞き」を繰り返すうちに、元の話の内容がデタラメになっていく状況に似ています。

なぜAIモデルの崩壊が起きるのか?

AI(特に生成AI)は、インターネット上の膨大なデータを学習して賢くなります。しかし、ネット上にAI製のコンテンツが増えることで、以下の悪循環が発生します。

- 第1世代→人間が作った「生のデータ」を学習(高品質)。

- 第2世代→第1世代が作った「AIデータ」を学習(わずかに劣化)。

- 第3世代→第2世代の「劣化したAIデータ」をさらに学習(大幅に劣化)。

これを繰り返すと、AIは「現実の正解」ではなく「AI特有のクセや間違い」を正解として学習してしまい、出力が劣化していきます。

崩壊によって起こる2つの主な問題

1、情報の均一化(多様性の喪失) 珍しいケースや例外的な情報が「ノイズ」として切り捨てられ、平凡で似たり寄ったりの回答しか出なくなる。

2、間違いの増幅、エラーの定着が起きる。AIが犯した小さな間違いを、次のAIが「真実」として学習する可能性が僅かに生じるため、デタラメな情報が修正不能なほど固定化される。

なぜ今、この問題が注目されているのか?

これまでのAI開発は、人間が数千年にわたって蓄積してきた「純粋なデータ」を利用できました。しかし、現在ネット上のAI生成のコンテンツが一斉に増えている状況であり、AIにとっての「新鮮で正しいエサ(人間による新しいデータ)」が枯渇し始めているため、非常に深刻な課題とされています。

解決策と展望

この「共食い状態」を防ぐために、以下のような対策が研究されています。

・データのフィルタリング 学習データからAI製のコンテンツを厳重に排除する。

・人間によるデータの保護 AI普及前の「汚染されていないデータ」をアーカイブし、基礎データとして守る。

・電子透かしの導入: AIが作ったものに識別信号を入れ、学習時に除外できるようにする。

AI企業は、モデルコラプスを防ぐための「新鮮なエサ(人間が書いた高品質な記事)」を確保するため、具体的な動きを加速させています。例えば、OPEN AIは『ウォール・ストリート・ジャーナル』や『タイムズ』などを傘下に持つNews Corpと5年で2.5億ドル(約400億円)規模と言われる提携を結んだり、人間同士のリアルな対話や最新のQ&Aデータを得るため、『Reddit』や『Stack Overflow』といったプラットフォームと直接契約しています。

収録の裏話

今回の収録は、最初はテレビ朝日のスタッフが弊社事務所までお越しくださり、そこで撮影を行いました。ただ、企画の進行に合わせて話す内容の方向性が少し変わったため、最終的にはZoomでのコメントどりという形になりました。

テレビの専門家コメントというと、ニュースなどで数秒だけ使われるパターンが多いのですが、今回はかなり長く使っていただけました。VTRの中で私のコメントがしっかり構成に組み込まれていて、単なる「識者の一言」ではなく、テーマの骨格を担う役割をいただけたのは嬉しかったです。

50番組という数字

テレビ出演はこれで50番組目になりました。NHK、日本テレビ、フジテレビ、TBS、テレビ朝日、テレビ東京、AbemaTVなど、さまざまに出演させていただいています。

2010年代はSNSやネット炎上の解説者として呼ばれることが多かった。観光でも少々ありましたね。2022年以降は、生成AIの専門家としての出演が増えています。テーマは変わっても、僕がテレビの現場で求められている役割はずっと同じです。「複雑なテクノロジーを、視聴者が自分ごととして受け取れる言葉に翻訳すること」。

50番組はひとつの区切りですが、通過点です。生成AIが社会に与えるインパクトはまだ始まったばかりで、伝えるべきことは増え続けています。

見逃した方へ

放送を見逃した方は、TVerで配信されています。出川さん、一茂さん、ホランさんの反応も含めて、生成AIに詳しくない方でも楽しめる内容になっていますので、ぜひご覧ください。

生成AIの導入支援やセミナー登壇のご依頼は、落合正和公式サイトよりお問い合わせください。

コメントを残す